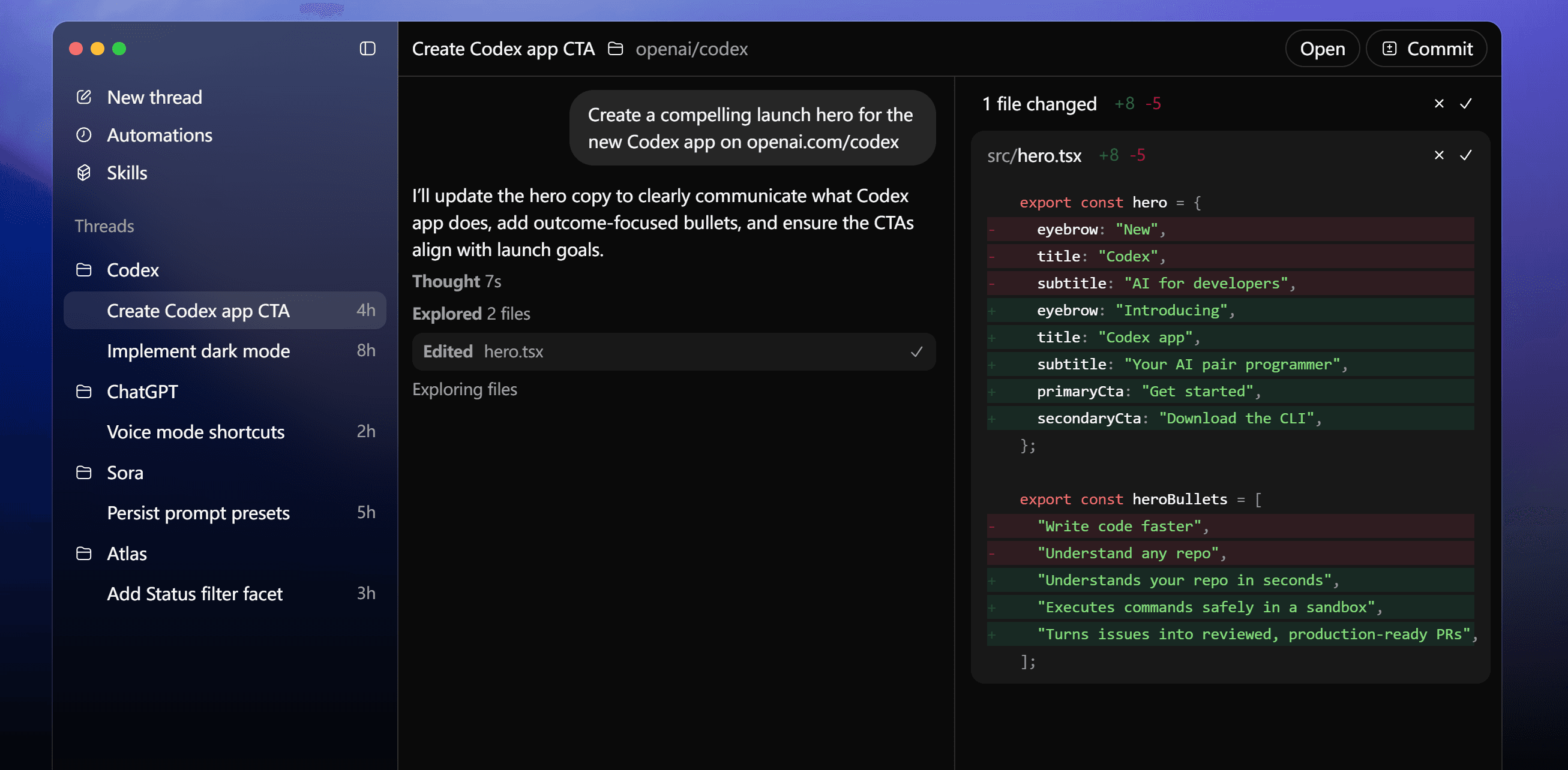

Codex Standalone-App (Codex App)

Installieren und konfigurieren Sie Mole API in der Codex Standalone-App als Modellanbieter. Melden Sie sich mit Ihrem API Key an und bearbeiten Sie `config.toml`, um sie zu verwenden.

Projektübersicht

Die Codex Standalone-App (Codex App) ist der Desktop-Client von Codex und bietet dieselben AI-Chat- und Programmierhilfen wie das Codex-Plugin in VS Code. In der Standalone-App können Sie Gespräche, Code-Vervollständigung und Erklärungen direkt durchführen, ohne den Editor zu öffnen. Durch die Konfiguration von Mole API als Modellanbieter können Sie einen einheitlichen Schlüssel- und Nutzungsmanagement-Workflow verwenden.

- Offizielle Website und Download: https://openai.com/codex

Anwendungsfälle

- Sie verwenden die Codex Standalone-App (Codex App) und möchten darin die Chat- und AI-Funktionen von Codex nutzen.

- Sie möchten Mole API als Modellzugangspunkt für Codex verwenden, um Nutzung und Schlüssel zentral zu verwalten.

Voraussetzungen

- Sie haben Ihren API Key bereits im Mole API Backend abgerufen (im persönlichen Bereich oder auf der Seite zur Token-Verwaltung erzeugt und kopiert).

Schritt 1: Codex herunterladen und installieren

- Öffnen Sie Ihren Browser und rufen Sie die offizielle Codex-Website auf: https://openai.com/codex.

- Laden Sie die Codex-App gemäß den Anweisungen auf der Seite herunter und installieren Sie sie.

Starten Sie nach der Installation die Codex-App.

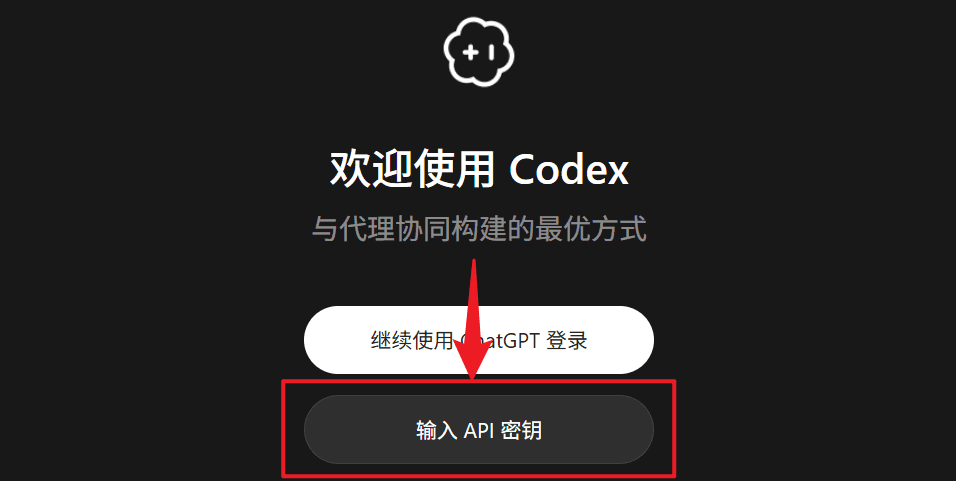

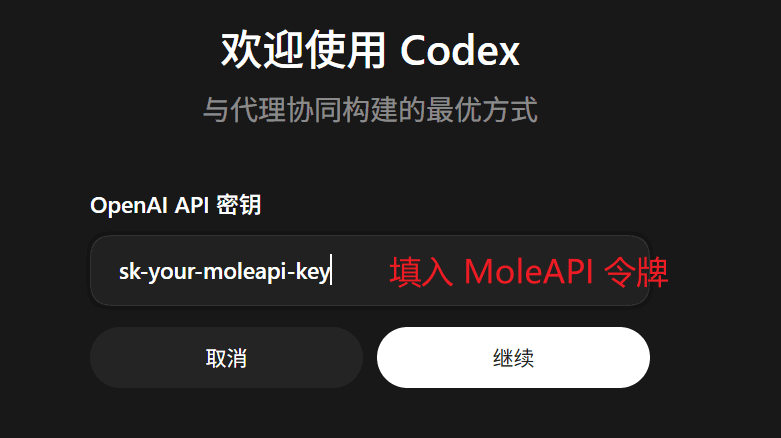

Schritt 2: Mit API Key anmelden

- Wählen Sie in der Codex-App die Anmeldung/Authentifizierung per API Key.

- Geben Sie den API Key ein, den Sie im Mole API Backend erhalten haben.

Hier wird nur der Schlüssel hinterlegt. Damit Codex tatsächlich Anfragen an Mole API sendet, müssen Sie in der Konfiguration zusätzlich den Modellanbieter festlegen.

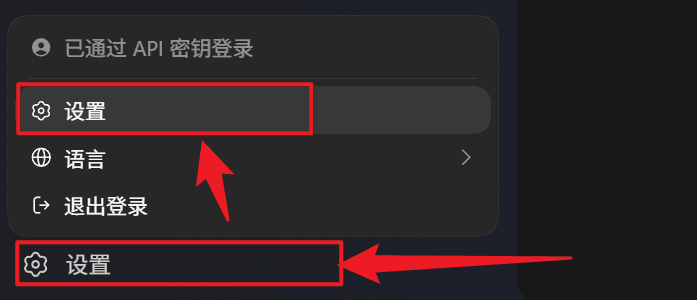

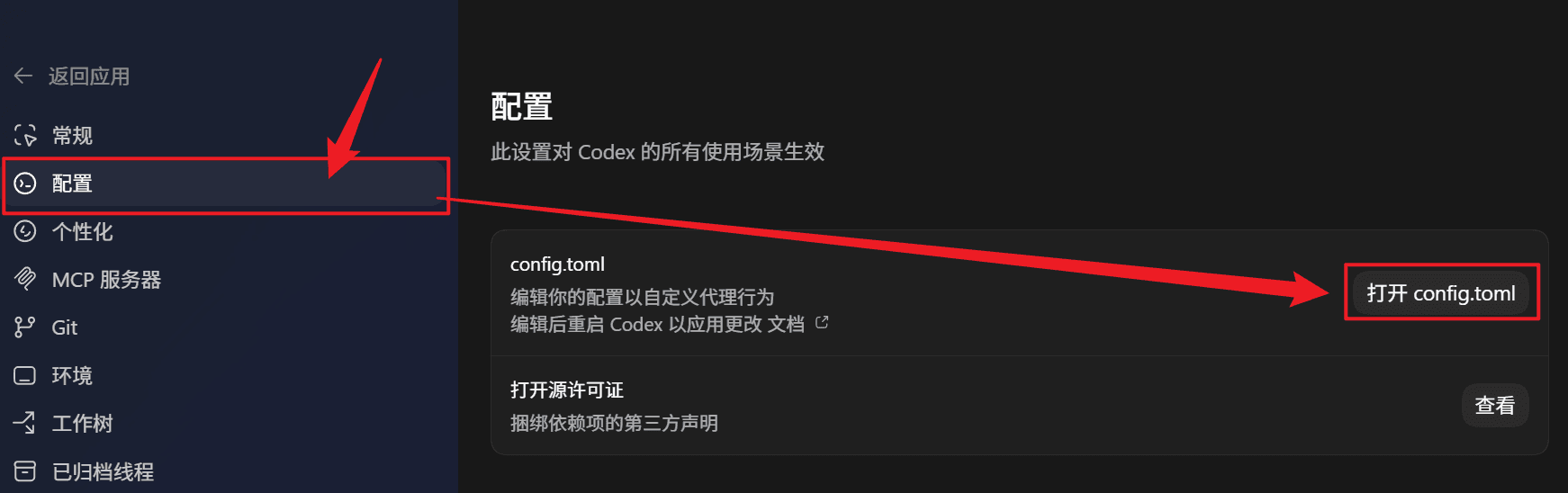

Schritt 3: Einstellungen öffnen und Konfiguration auswählen

- Klicken Sie nach der Anmeldung auf Einstellungen → Einstellungen.

- Wählen Sie in den Einstellungen Konfiguration aus und öffnen Sie

config.toml.

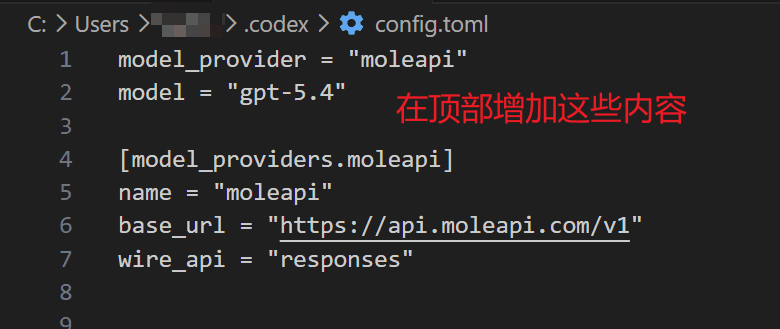

Schritt 4: Mole API in config.toml konfigurieren

Fügen Sie in der geöffneten config.toml den folgenden Inhalt hinzu:

model_provider = "moleapi"

[model_providers.moleapi]

name = "moleapi"

base_url = "https://api.moleapi.com/v1"

wire_api = "responses"Sie können außerdem model = "das von moleapi bereitgestellte Modell, das Sie verwenden möchten, z. B. claude-opus-4-6" hinzufügen.

Speichern Sie config.toml und starten Sie Codex neu, damit die Konfiguration wirksam wird.

Schritt 5: Überprüfen, ob die Konfiguration erfolgreich war

- Öffnen Sie Codex erneut und senden Sie im Eingabefeld eine Nachricht (z. B. „Hallo“).

- Wenn Codex normal antwortet und Sie im Anfrageprotokoll des Mole API Backends den entsprechenden Anfrageeintrag für diesen API Key sehen, wurde Mole API erfolgreich als Modellanbieter für Codex konfiguriert.

Häufige Probleme

Beim Senden von Nachrichten gibt es keine Reaktion oder es tritt ein Fehler auf

- Stellen Sie sicher, dass

model_provider = "moleapi"und[model_providers.moleapi]inconfig.tomlkorrekt eingetragen und gespeichert wurden. - Stellen Sie sicher, dass base_url auf

https://api.moleapi.com/v1gesetzt ist. Lassen Sie/v1nicht weg und fügen Sie keinen zusätzlichen Pfad hinzu. - Stellen Sie sicher, dass der eingetragene API Key mit dem im Mole API Backend übereinstimmt und nicht abgelaufen ist. Nach Änderungen an der Konfiguration müssen Sie Codex neu starten.

Modell oder Endpunkt ändern

Im Mole API Backend können Sie verfügbare Modelle und die Nutzung verwalten. Wenn Sie auf der Codex-Seite den Endpunkt oder Anbieter ändern möchten, passen Sie in config.toml model_provider sowie die entsprechende Konfiguration unter [model_providers.*] an und starten Sie Codex anschließend neu.

Referenzlinks

War diese Anleitung hilfreich?

Zuletzt aktualisiert am

AI-Anwendungen

Unterstützte AI-Anwendungen und Integrationslösungen

AionUi - Kostenloser Open-Source-Agent für Desktop-Büroarbeit

AionUi-Tutorial — kostenloser Open-Source-Agent für Desktop-Büroarbeit mit Unterstützung für Gemini CLI, Claude Code, Codex und weitere AI-Agents. Anbindung an MoleAPI zur Umsetzung von Multi-Model-Workflows.