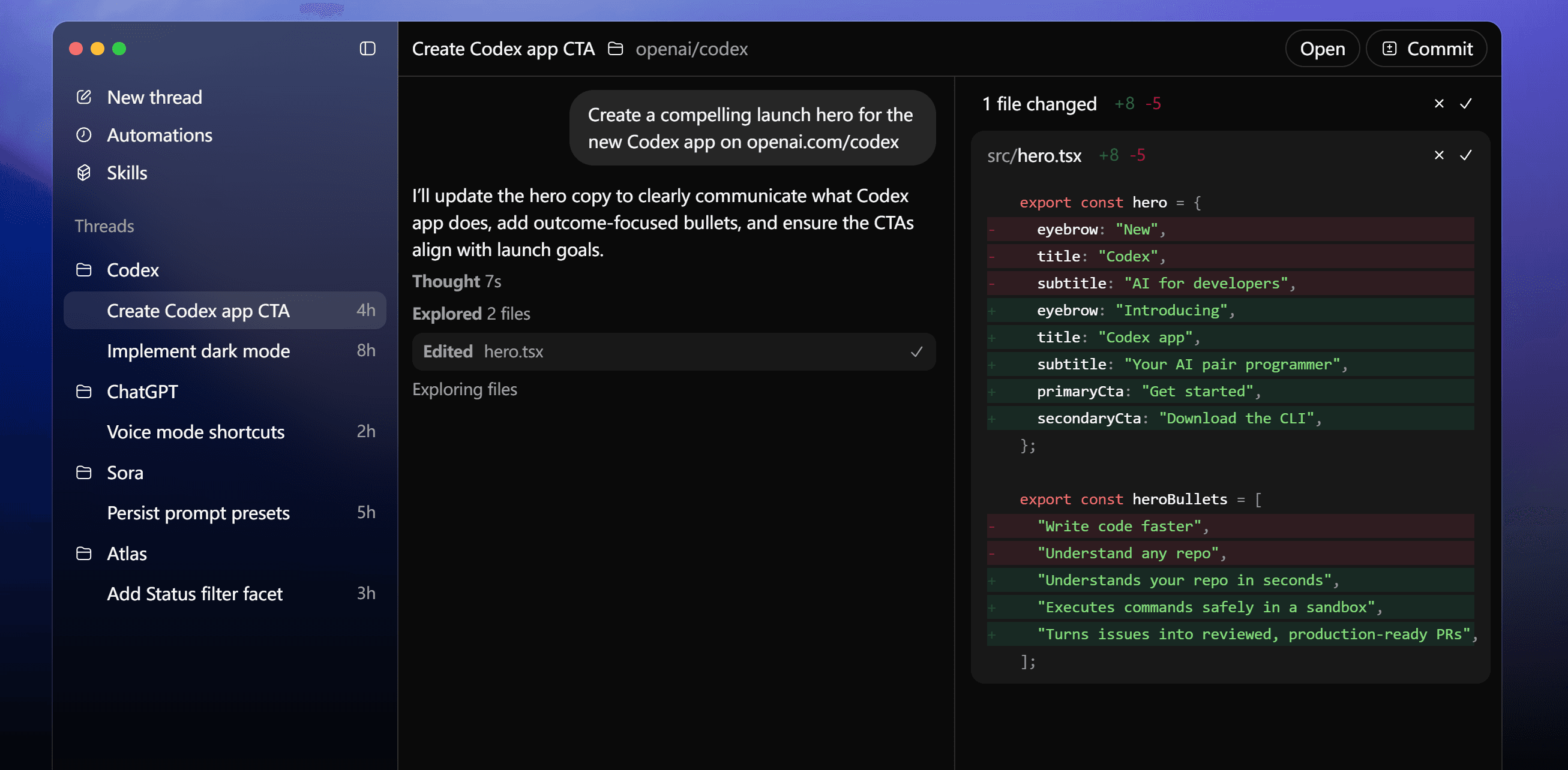

Application autonome Codex (Codex App)

Installez et configurez Mole API comme fournisseur de modèles dans l’application autonome Codex. Connectez-vous avec une API Key et modifiez `config.toml` pour commencer à l’utiliser.

Présentation du projet

L’application autonome Codex (Codex App) est le client de bureau de Codex. Elle offre les mêmes capacités de conversation IA et d’assistance à la programmation que l’extension Codex dans VS Code. Dans l’application autonome, vous pouvez dialoguer, obtenir de l’autocomplétion de code et des explications, sans ouvrir l’éditeur. En configurant Mole API comme fournisseur de modèles, vous pouvez utiliser une gestion unifiée des clés et de la consommation.

- Site officiel et téléchargement : https://openai.com/codex

Cas d’usage

- Vous utilisez l’application autonome Codex (Codex App) et souhaitez y profiter des fonctionnalités de conversation et des capacités IA de Codex.

- Vous souhaitez utiliser Mole API comme point d’accès aux modèles pour Codex afin de gérer de manière centralisée la consommation et les clés.

Prérequis

- Vous avez déjà obtenu votre API Key dans le console Mole API (générée et copiée depuis la page du centre personnel ou de gestion des tokens).

Étape 1 : Télécharger et installer Codex

- Ouvrez votre navigateur et accédez au site officiel de Codex : https://openai.com/codex.

- Suivez les instructions de la page pour télécharger et installer l’application Codex.

Une fois l’installation terminée, lancez l’application Codex.

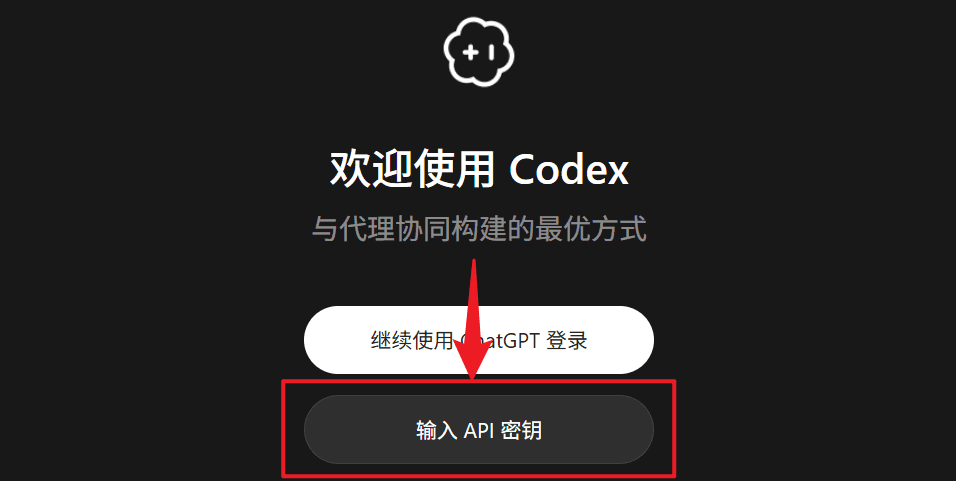

Étape 2 : Se connecter avec une API Key

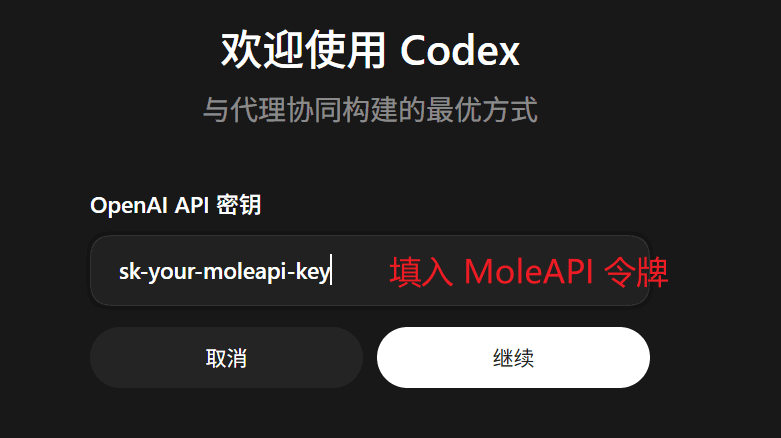

- Dans l’application Codex, choisissez le mode de connexion/authentification API Key.

- Saisissez l’API Key obtenue dans le console Mole API.

À cette étape, seule la clé est enregistrée. Pour que Codex envoie réellement des requêtes à Mole API, vous devez également spécifier le fournisseur de modèles dans la configuration.

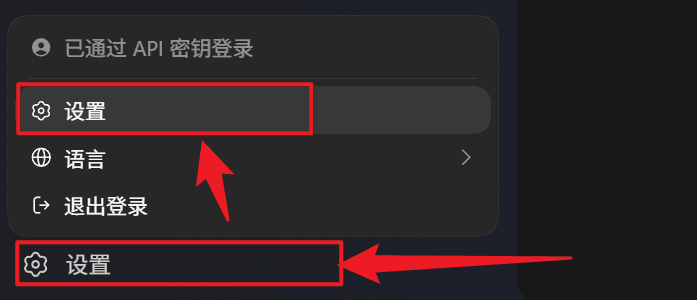

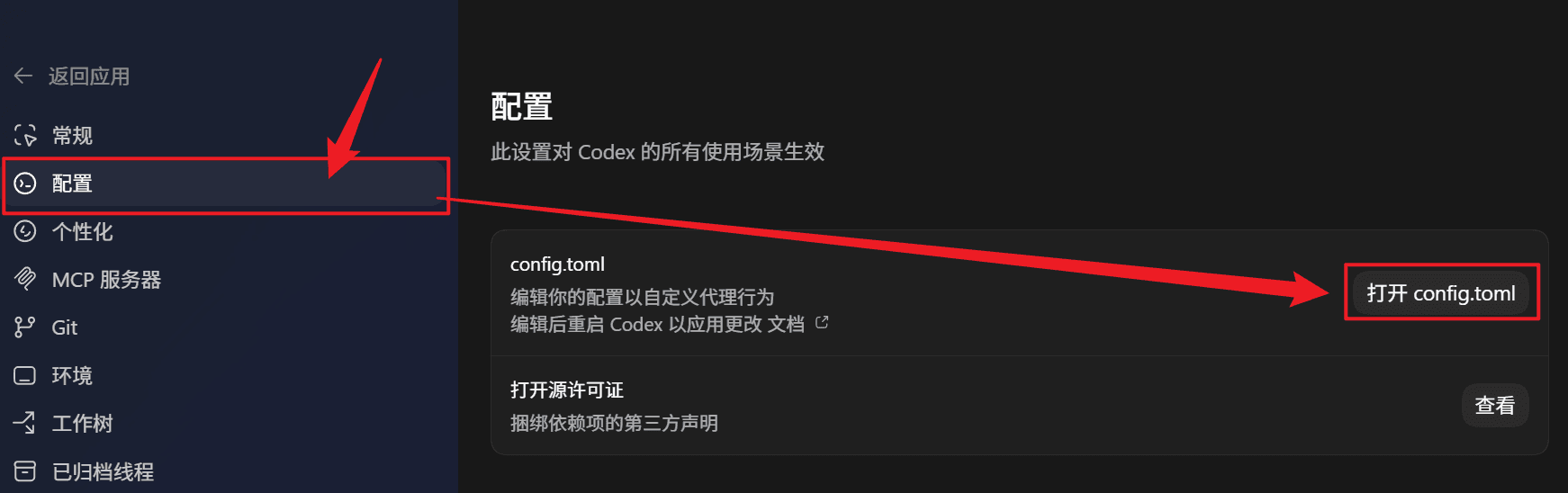

Étape 3 : Ouvrir les paramètres et choisir la configuration

- Après la connexion, ouvrez Paramètres → Paramètres.

- Dans les paramètres, sélectionnez Configuration pour ouvrir

config.toml.

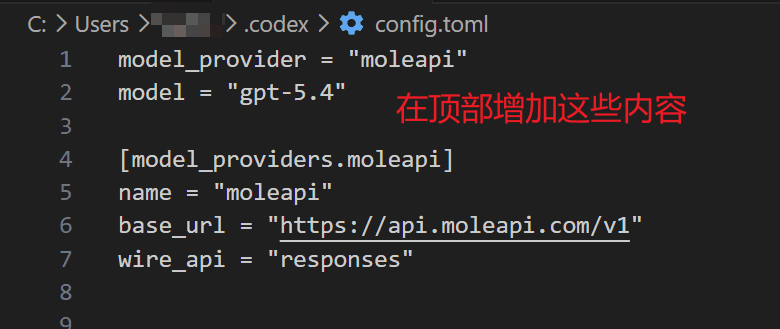

Étape 4 : Configurer Mole API dans config.toml

Ajoutez le contenu suivant dans le config.toml ouvert :

model_provider = "moleapi"

[model_providers.moleapi]

name = "moleapi"

base_url = "https://api.moleapi.com/v1"

wire_api = "responses"Vous pouvez également ajouter model = "le modèle MoleAPI que vous souhaitez utiliser, par exemple claude-opus-4-6".

Après avoir enregistré config.toml, redémarrez Codex pour appliquer la configuration.

Étape 5 : Vérifier que la configuration a bien réussi

- Ouvrez à nouveau Codex et envoyez un message dans le champ de saisie (par exemple « Bonjour »).

- Si Codex répond normalement et que vous voyez la requête correspondante pour cette API Key dans les logs de requêtes du console Mole API, cela signifie que Mole API a bien été configuré comme fournisseur de modèles de Codex.

Questions fréquentes

Aucun retour ou une erreur lors de l’envoi d’un message

- Vérifiez que

model_provider = "moleapi"et[model_providers.moleapi]dansconfig.tomlsont correctement renseignés et que le fichier a bien été enregistré. - Vérifiez que base_url est bien

https://api.moleapi.com/v1; n’oubliez pas/v1et n’ajoutez pas de chemin supplémentaire. - Vérifiez que l’API Key saisie correspond bien à celle du console Mole API et qu’elle n’a pas expiré. Après toute modification de la configuration, vous devez redémarrer Codex.

Changer de modèle ou d’endpoint

Dans le console Mole API, vous pouvez gérer les modèles disponibles et la consommation. Côté Codex, si vous devez changer d’endpoint ou de fournisseur, modifiez model_provider ainsi que la configuration correspondante [model_providers.*] dans config.toml, puis redémarrez Codex.

Liens de référence

Ce guide vous a-t-il aidé ?

Dernière mise à jour le

Applications AI

Applications AI prises en charge et solutions d’intégration

AionUi - Agent bureautique de bureau gratuit et open source

Tutoriel AionUi — agent bureautique de bureau gratuit et open source, compatible avec Gemini CLI, Claude Code, Codex et d’autres agents IA. Connectez-le à MoleAPI pour mettre en place des workflows multi-modèles.