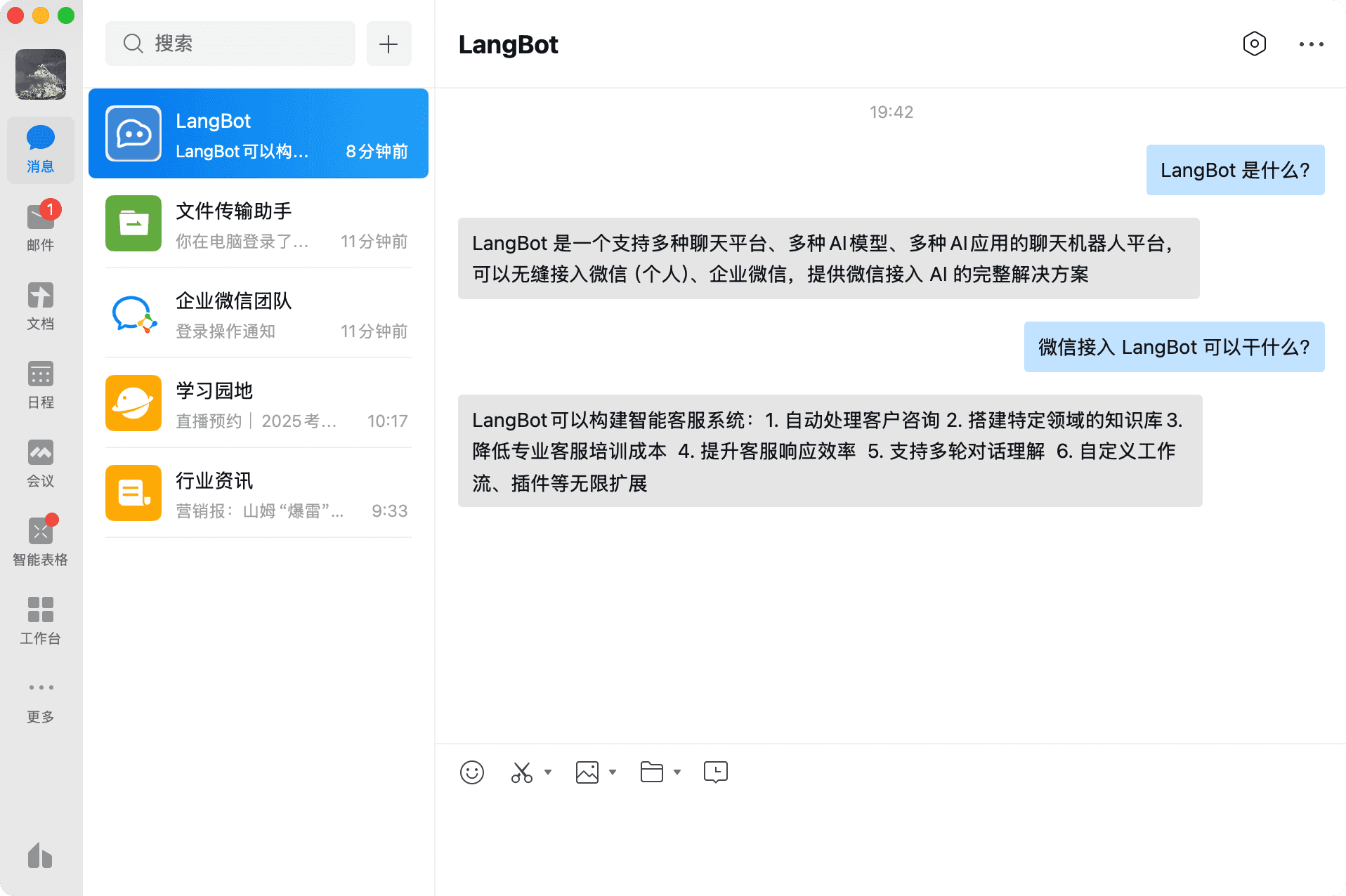

LangBot - Plateforme de développement de bots de messagerie instantanée

Tutoriel d’intégration de LangBot — Framework de développement de bots de chat IA pour des plateformes telles que Feishu, DingTalk, Telegram, Discord, etc. Prend en charge les bases de connaissances, Agent, MCP et est compatible avec MoleAPI.

LangBot est une plateforme open source de développement de bots de messagerie instantanée, compatible avec de nombreuses plateformes de messagerie instantanée, telles que Feishu, DingTalk, WeChat, QQ, Telegram, Discord, Slack, etc. Elle permet d’accéder aux principaux modèles d’IA mondiaux, prend en charge diverses capacités d’applications IA comme les bases de connaissances, Agent et MCP, et s’adapte parfaitement à MoleAPI.

- Site officiel : https://langbot.app

- Téléchargement : https://github.com/langbot-app/LangBot/releases

- Documentation officielle : https://docs.langbot.app

- Dépôt open source : https://github.com/langbot-app/LangBot

Intégrer MoleAPI

LangBot prend parfaitement en charge l’utilisation avec MoleAPI, et la procédure est très simple.

Mode d’utilisation

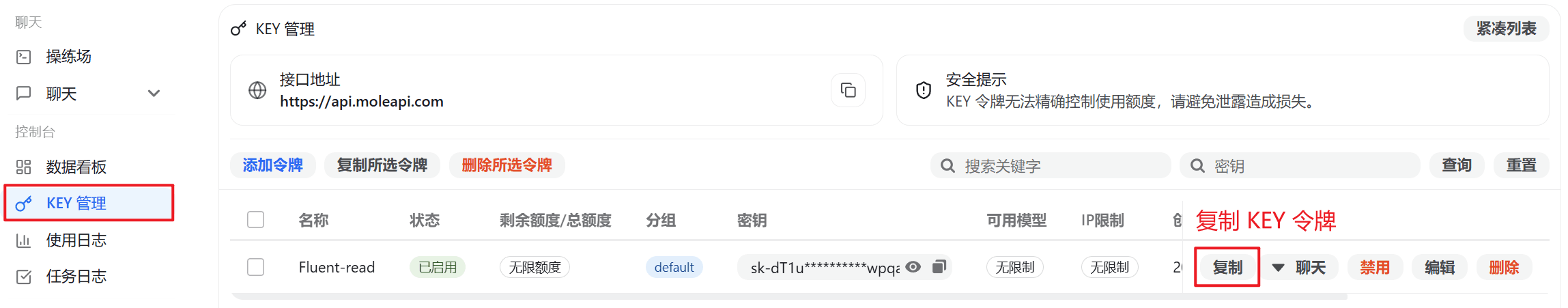

- Récupérez l’API Key et la Base URL depuis MoleAPI

Veuillez noter que l’adresse API (Base URL) doit se terminer par /v1.

Par exemple, la valeur correcte est :

https://api.moleapi.com/v1Si /v1 n’est pas ajouté, l’intégration ne fonctionnera pas correctement.

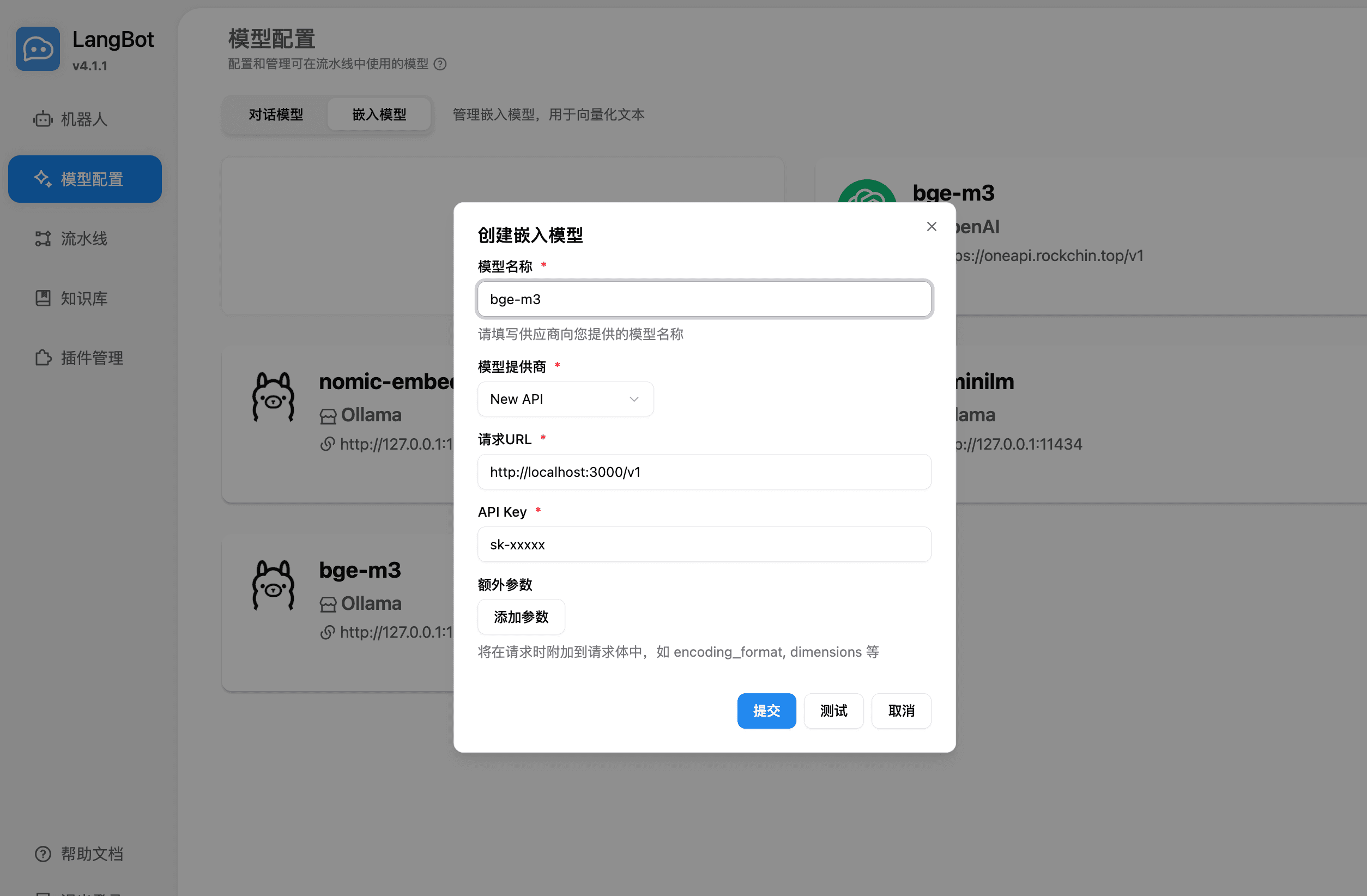

-

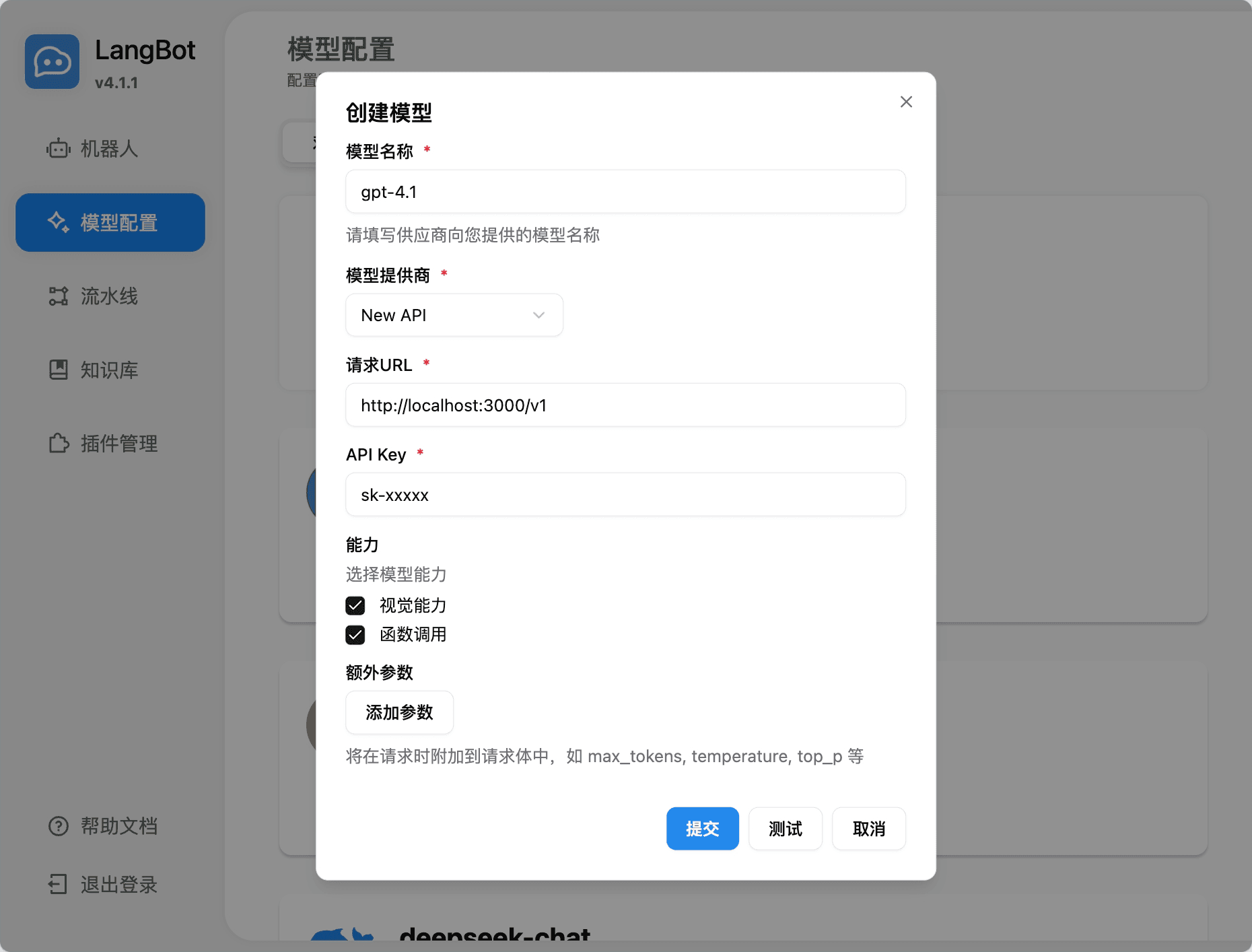

Ajoutez un modèle dans LangBot, sélectionnez le fournisseur NewAPI, puis renseignez l’API Key et l’adresse API correspondantes

-

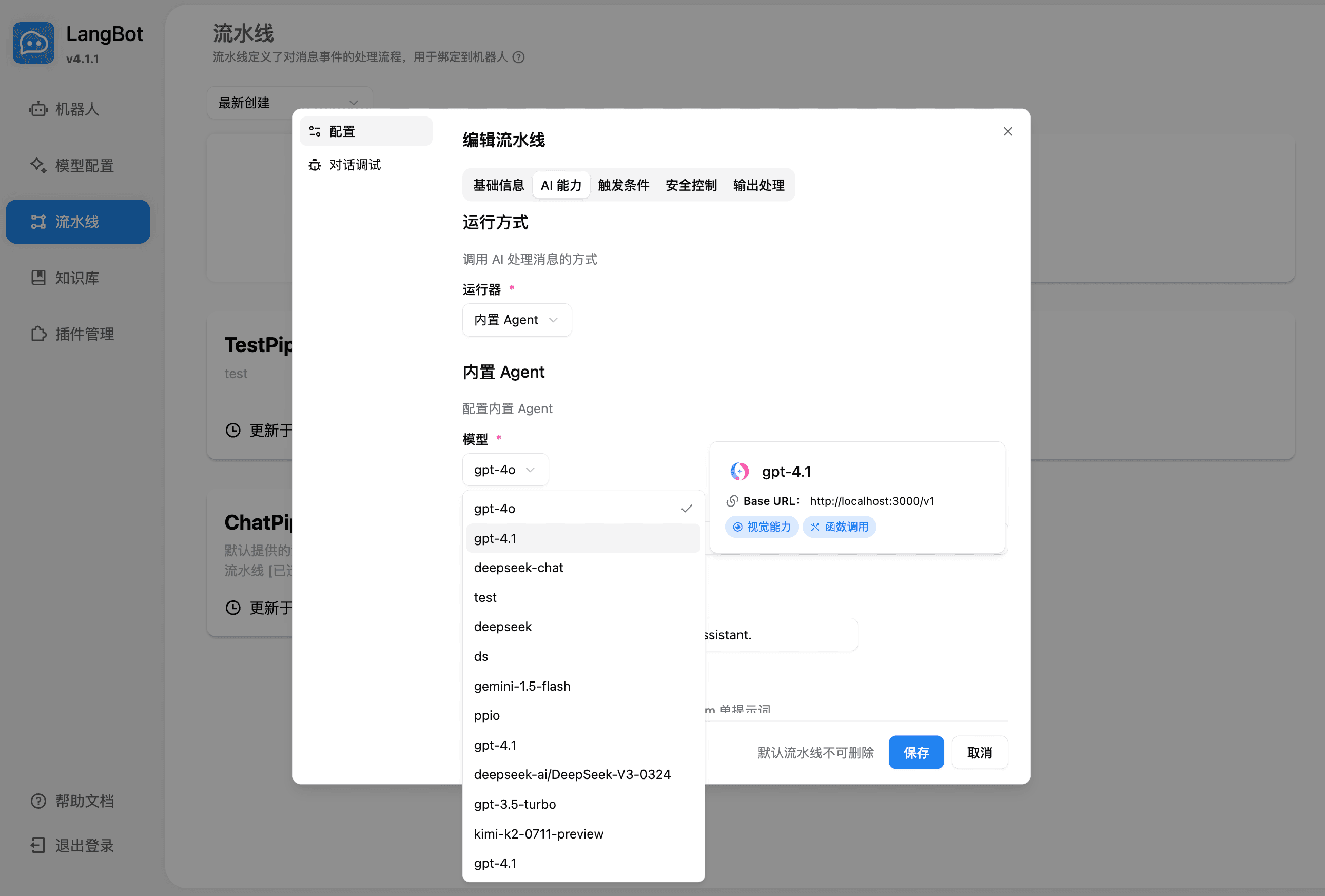

Sélectionnez le modèle à utiliser dans le pipeline

-

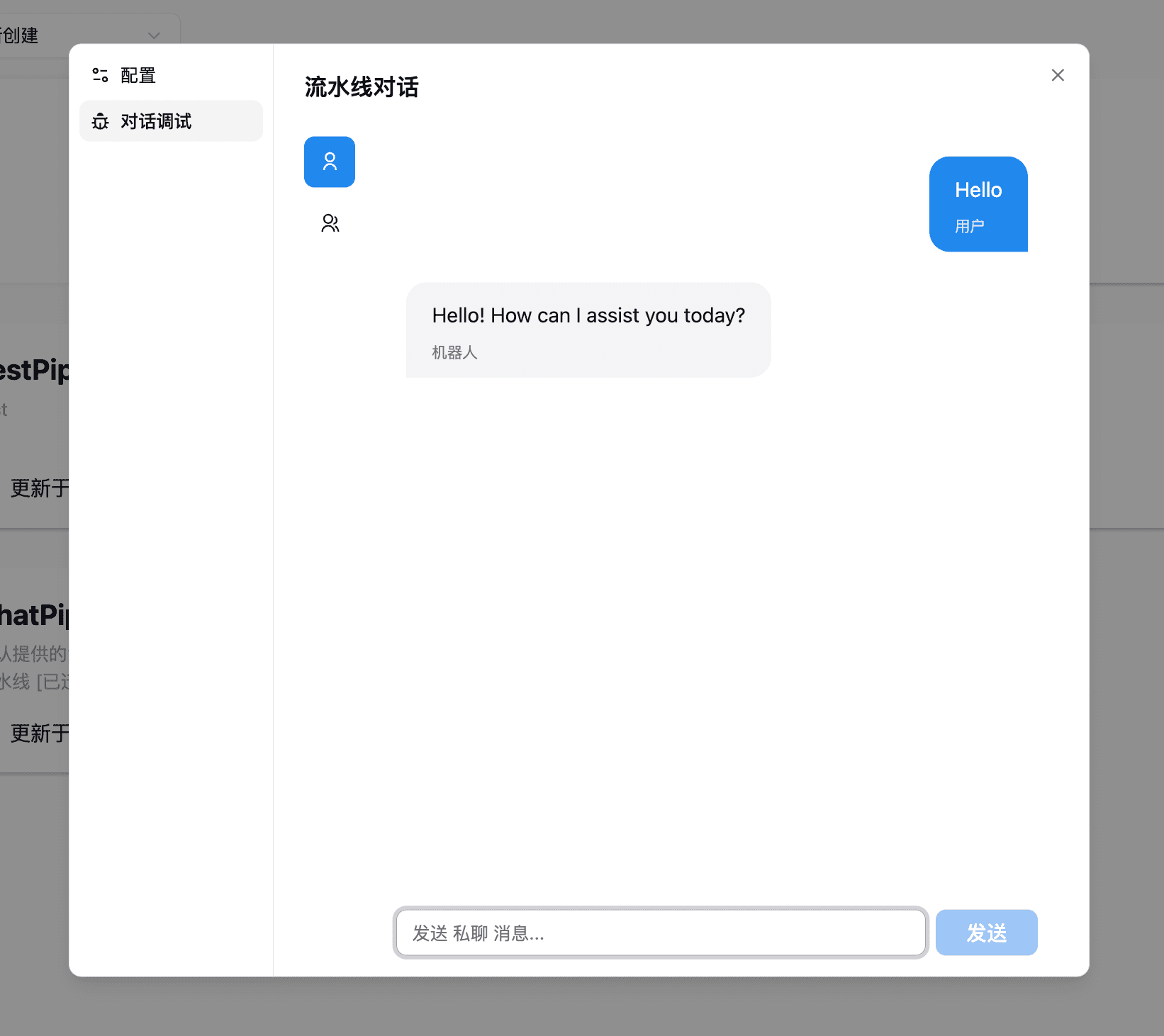

Utilisez-le dans le débogage de conversation ou en discutant avec le bot associé au pipeline

Pour la configuration de déploiement du bot, veuillez consulter Déployer un bot.

Utiliser la base de connaissances de LangBot

LangBot prend en charge l’utilisation des modèles d’embedding de MoleAPI et peut les utiliser comme modèles vectoriels pour la base de connaissances.

-

Ajoutez un modèle d’embedding dans LangBot, puis sélectionnez le fournisseur NewAPI

-

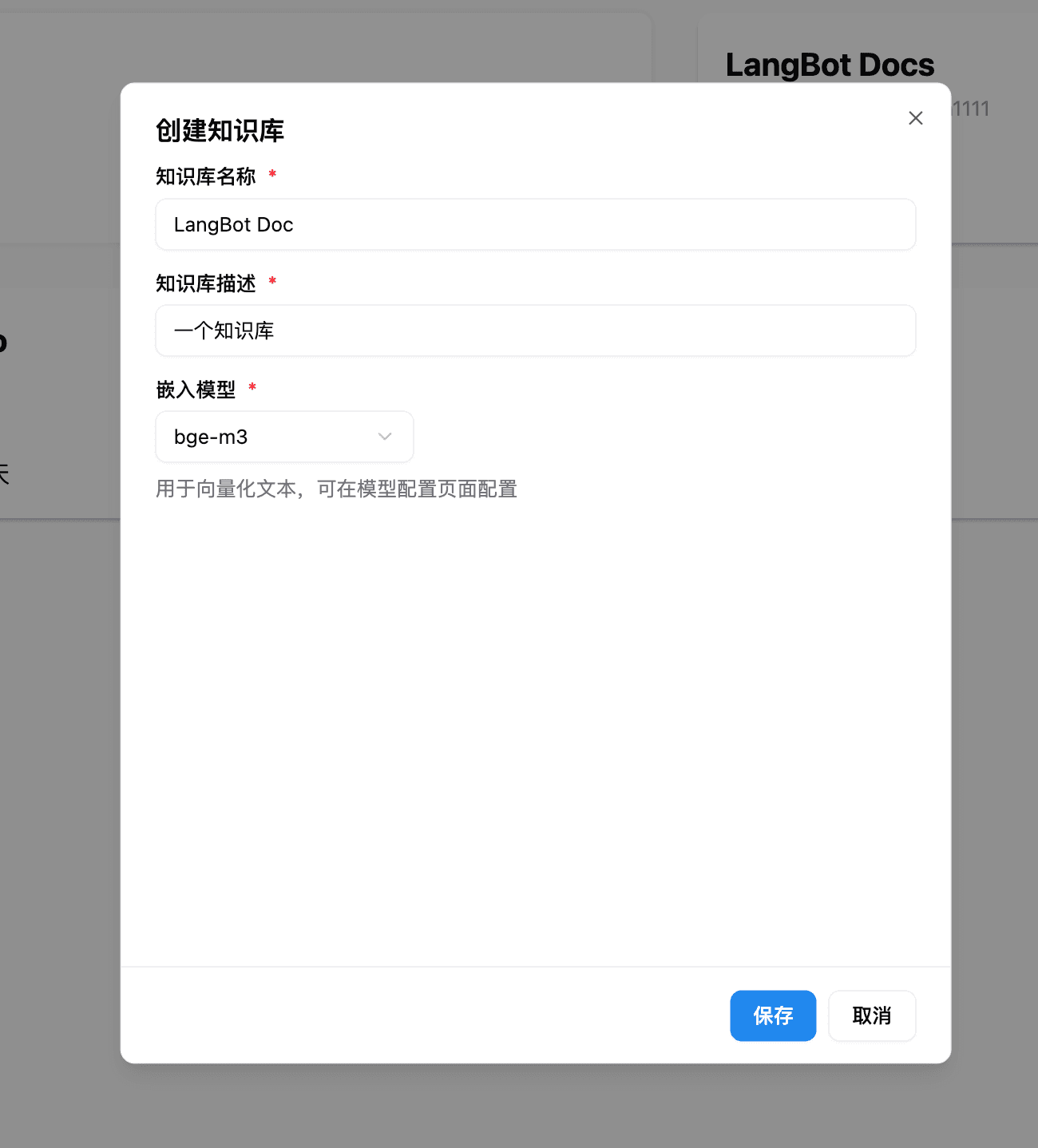

Lors de la création d’une nouvelle base de connaissances, sélectionnez le modèle d’embedding ajouté précédemment comme backend de recherche vectorielle afin de construire une base de connaissances intelligente prenant en charge la compréhension sémantique.

-

Une fois la création terminée, vous pouvez effectuer dans la base de connaissances LangBot une recherche sémantique et un système de questions-réponses basés sur les embeddings de MoleAPI.

-

Vous pouvez ajuster davantage les paramètres du modèle vectoriel dans les paramètres de la base de connaissances afin de répondre à des besoins de recherche plus complexes.

Pour plus de modes d’utilisation, consultez la documentation officielle de LangBot : https://docs.langbot.app

Ce guide vous a-t-il aidé ?

Dernière mise à jour le

OpenClaw - Assistant IA auto-hébergé

Tutoriel OpenClaw — installez OpenClaw, connectez-le à New API et déployez rapidement un assistant IA auto-hébergé. Projet open source, avec prise en charge de l’intégration multicanal comme Lark, Discord et Slack.

AstrBot - Robot conversationnel Agent

Tutoriel de configuration AstrBot — connectez la plateforme open source de robot conversationnel Agent à MoleAPI afin d’apporter des capacités d’IA à QQ, Feishu, DingTalk, WeCom et d’autres outils de messagerie instantanée.